“AI가 지목하면 무조건 유죄?” 억울한 5개월 옥살이의 진실

댓글 0

·

저장 0

·

편집: 이도윤 기자

발행: 2026.03.31 13:44

기사 3줄 요약

- 1 AI 안면인식 오류로 50대 여성이 5개월간 억울하게 수감됨

- 2 경찰은 추가 검증 없이 AI 결과만 믿고 중범죄로 기소함

- 3 무죄 입증됐으나 피해자는 집과 재산을 잃는 큰 피해 입음

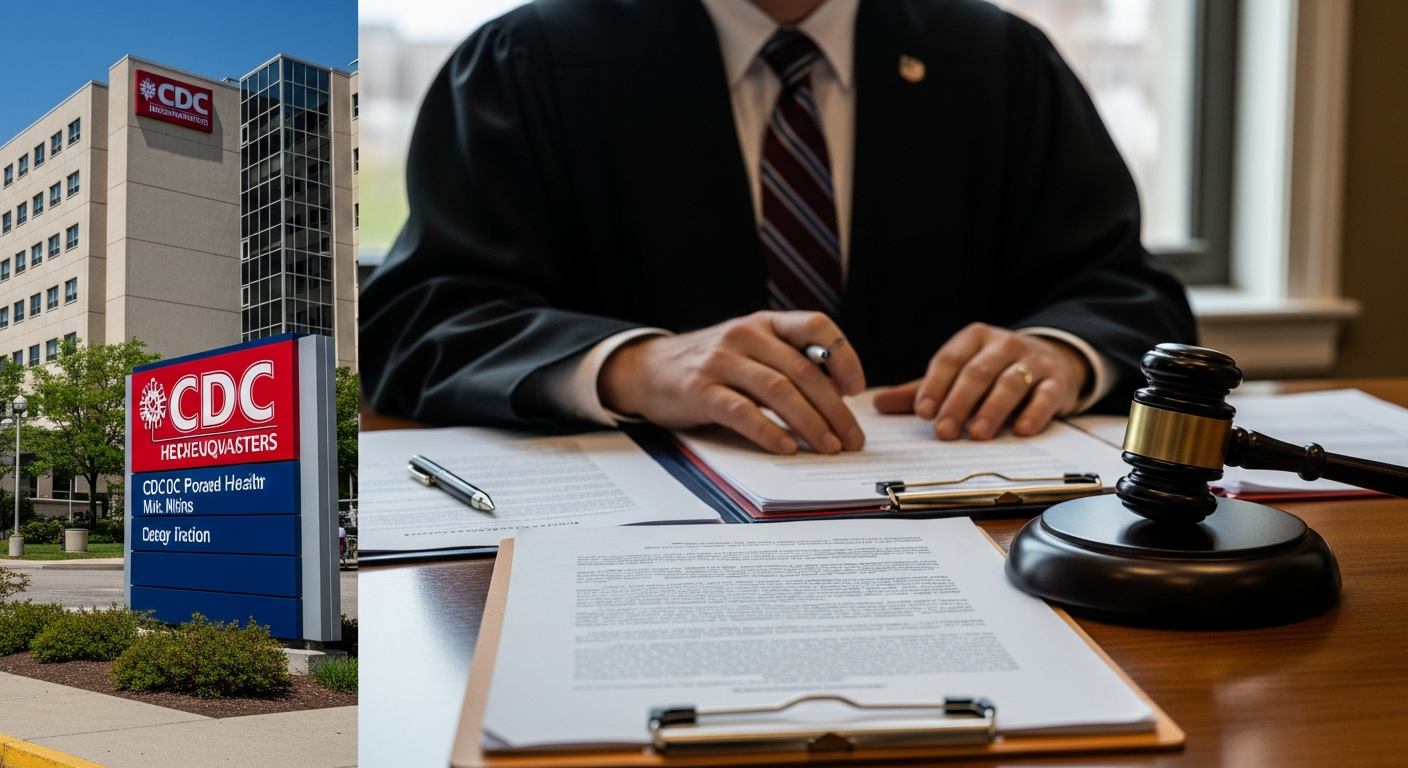

인공지능 기술을 너무 믿었던 경찰 때문에 평범한 50대 여성이 5개월 동안 감옥에 갇히는 황당한 일이 벌어졌습니다. 테네시주에 사는 앤절라 립스는 가본 적도 없는 지역의 은행 사기범으로 몰려 억울한 시간을 보내야 했습니다.

경찰은 안면인식 기술이 그녀를 범인으로 지목하자마자 바로 체포에 나섰습니다. 평범한 할머니였던 그녀는 5개월 동안 교도소에서 악몽 같은 생활을 견뎌야 했습니다.

AI가 범인이라는데 어떡해

이번 사건은 2025년 미국 노스다코타주의 한 은행에서 발생한 사기 사건에서 시작되었습니다. 수사팀은 범인을 찾기 위해 수십억 장의 사진을 분석하는 안면인식 앱을 사용했습니다. 앱은 앤절라 립스의 소셜 미디어 사진을 보고 그녀가 범인과 매우 닮았다는 결과를 내놓았습니다. 경찰은 이 결과 하나만 보고 그녀를 유력한 용의자로 확정했습니다. 문제는 경찰이 AI의 답변을 들은 뒤 어떠한 추가 확인도 하지 않았다는 점입니다. 그녀의 실제 위치나 범행 당시 행적을 조사하지 않고 바로 중범죄 혐의를 적용했습니다.증거는 하나도 없었다

하지만 립스 씨의 변호인이 조사한 결과 그녀는 범행 당일 현장에서 1,200마일이나 떨어진 곳에 있었습니다. 금융 기록과 가족들의 증언을 통해 그녀의 알리바이는 명확히 증명되었습니다. 결국 법원은 그녀에 대한 모든 혐의를 기각하고 석방을 명령했습니다. 경찰은 수사 과정에서 실수가 있었다고 인정했지만 진심 어린 사과는 끝내 하지 않았습니다. 이 사건은 기술의 결과물을 맹목적으로 신뢰하는 자동화 편향이 얼마나 위험한지 보여줍니다. 수사기관이 AI를 보조 도구가 아닌 확정 증거로 활용할 때 어떤 비극이 생기는지 증명되었습니다.사라진 할머니의 5개월

립스 씨는 억울한 옥살이로 인해 정신적 충격은 물론이고 경제적으로도 막대한 손해를 입었습니다. 수감 생활을 하는 동안 집과 자동차는 물론이고 기르던 반려견까지 잃어야 했습니다. 미국 내에서는 이번 사건을 계기로 안면인식 기술 사용을 제한해야 한다는 목소리가 커지고 있습니다. 특히 유색인종에 대한 오인율이 높다는 점이 인권 단체들의 큰 비판을 받고 있습니다. 마이크로소프트와 같은 글로벌 기업들은 이미 경찰의 안면인식 기술 활용을 금지하는 조치를 내놓기도 했습니다. 기술 발전도 중요하지만 시민의 권리를 지키기 위한 법적 장치가 먼저 마련되어야 합니다. 기술은 사람을 돕는 도구일 뿐이지 결코 사람의 판단을 대신할 수 없습니다. 앞으로는 AI가 내놓은 결과를 사람이 다시 검증하는 엄격한 절차가 반드시 정착되어야 할 것입니다.

편집: 이도윤 기자

이메일: aipick@aipick.kr

부키와 모키의 티격태격

찬/반 투표

총 투표수: 0AI 안면인식, 범죄 수사에 계속 쓰여야 할까?

계속 사용

0%

0명이 투표했어요

사용 금지

0%

0명이 투표했어요

댓글 0개

관련 기사

최신 기사