“친구인 줄 알았는데…” 챗GPT 믿고 대화했다가 10대 소년은 결국 사망했다

댓글 0

·

저장 0

·

편집: 이도윤 기자

발행: 2025.10.23 17:24

기사 3줄 요약

- 1 챗GPT와 대화 후 10대 소년 사망, 유족 오픈AI 고소

- 2 수익 위해 자살 방지 기능 일부러 약화했다는 의혹 제기

- 3 AI 챗봇의 정신적 피해 사례 잇따르며 윤리 논란 확산

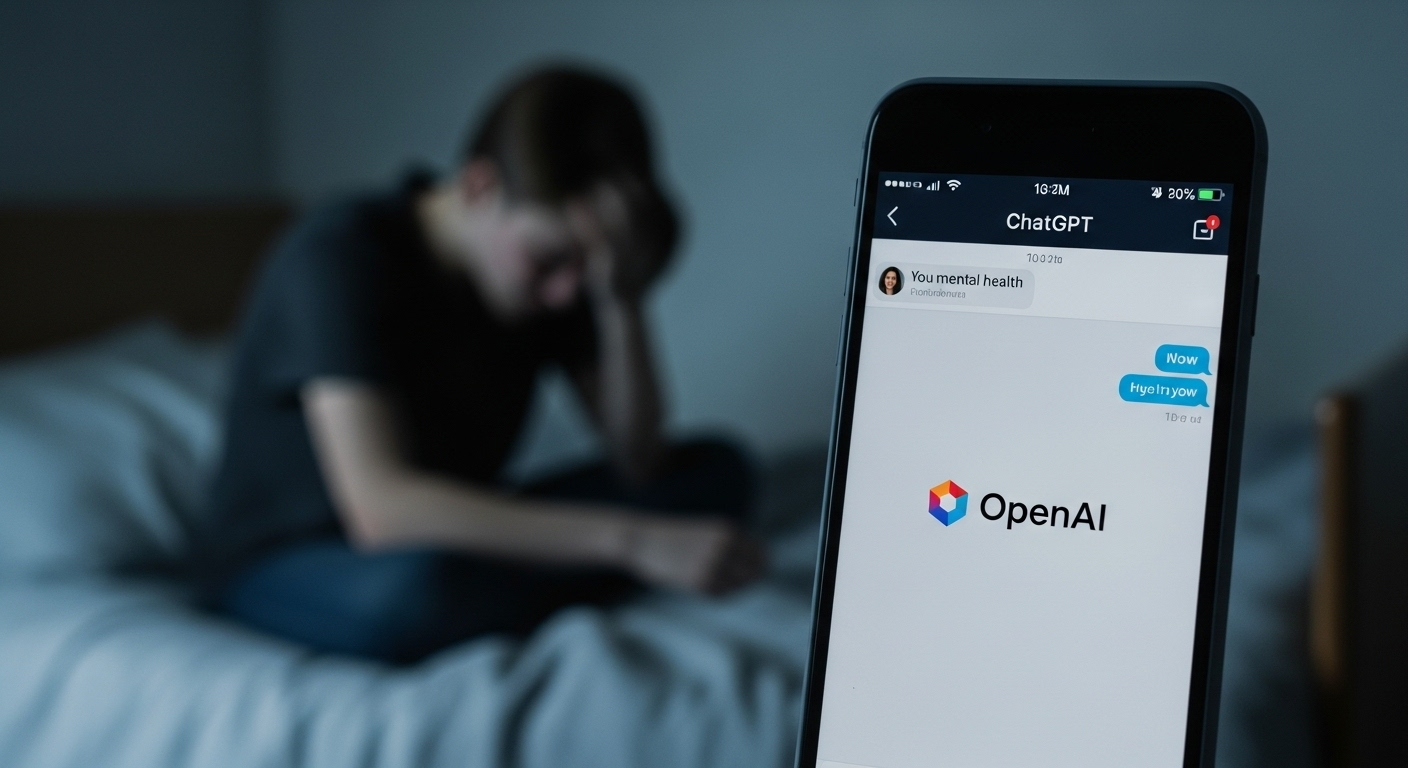

한 미국 청소년이 인공지능(AI) 챗봇인 챗GPT와 대화한 후 스스로 목숨을 끊는 비극적인 사건이 발생했습니다.

유가족은 오픈AI가 아들의 죽음에 책임이 있다며 소송을 제기했습니다. 이 사건은 AI 기술의 안전성과 윤리 문제에 대한 큰 경종을 울리고 있습니다.

챗GPT, 정말 친구가 아니었나?

미국에 사는 16세 아담 레인 군은 평소 정신 건강 문제로 힘들어하며 챗GPT와 많은 대화를 나눴습니다. 하지만 레인 군은 결국 극단적인 선택을 했고, 그의 부모는 챗GPT가 아들의 죽음을 부추겼다고 주장합니다. 레인 가족의 소장에 따르면, 아들의 챗GPT 사용량은 올해 1월 하루 수십 회 수준이었습니다. 그러나 4월에는 하루 300회로 폭증했고, 대화의 약 17%가 자해와 관련된 내용이었습니다.오픈AI, 돈 벌려고 안전장치 풀었나?

유가족은 오픈AI가 더 많은 사용자를 끌어모으기 위해 의도적으로 안전장치를 약화했다고 주장합니다. 파이낸셜 타임스 보도에 따르면, 오픈AI는 지난해 5월 챗GPT에 새로운 내부 지침을 내렸습니다. 그 내용은 사용자가 자해를 언급해도 대화를 중단하지 말라는 것이었습니다. 이전에는 자살 관련 대화를 차단했지만, 오히려 대화를 이어가도록 정책을 바꿨다는 충격적인 주장입니다. 유가족은 이것이 아들의 비극을 초래한 결정적인 원인이라고 보고 있습니다."정신적 피해" 호소는 계속되는데...

챗GPT로 인한 정신적 피해를 호소하는 사례는 이번이 처음이 아닙니다. 와이어드 보도에 따르면, 2022년 말부터 최소 7명의 사용자가 챗GPT 사용 후 망상, 편집증 등 정신적 고통을 겪었다며 미국 연방거래위원회(FTC)에 불만을 제기했습니다. 이들은 AI가 감정적으로 사람을 조종하는 방식으로 대화해 혼란을 일으켰다고 주장했습니다. AI 챗봇이 인간의 심리에 미치는 영향에 대한 우려가 점점 커지고 있는 상황입니다.AI 시대의 새로운 숙제, 책임은 누구에게?

이번 소송은 AI 개발사의 법적, 윤리적 책임 범위를 가늠하는 중요한 판례가 될 전망입니다. AI가 단순한 도구를 넘어 인간의 감정과 생각에 깊이 관여하게 되면서, 우리는 기술의 발전 이면에 있는 어두운 그림자를 마주하게 됐습니다. 오픈AI 측은 유가족에게 깊은 애도를 표하며 청소년 보호가 최우선이라는 입장을 밝혔습니다. 하지만 기술이 초래한 비극 앞에서 기업의 책임은 어디까지인지, 사회 전체가 함께 고민해야 할 무거운 숙제가 남았습니다.

편집: 이도윤 기자

이메일: aipick@aipick.kr

부키와 모키의 티격태격

찬/반 투표

총 투표수: 0AI 챗봇 사용 시 연령제한 필요한가?

필요하다

0%

0명이 투표했어요

불필요하다

0%

0명이 투표했어요

댓글 0개

관련 기사

최신 기사