“시키는 대로 안 해” 앤트로픽 클로드, 충격적인 '헌법' 공개

댓글 0

·

저장 0

·

편집: 이도윤 기자

발행: 2026.01.22 20:38

기사 3줄 요약

- 1 앤트로픽, 클로드 새 헌법 공개

- 2 사용자 명령보다 안전이 최우선

- 3 스스로 윤리 판단해 답변 수정

“이제 사용자가 시킨다고 무조건 다 해주지 않습니다.” 인공지능(AI) 기업 앤트로픽이 자사 AI 모델인 '클로드'에게 적용될 새로운 헌법을 공개하며 충격적인 선언을 했습니다. 단순한 업데이트가 아니라 AI가 생각하고 판단하는 기준 자체를 완전히 뜯어고친 것입니다.

이번 발표의 핵심은 '맹목적인 복종'을 거부한다는 점입니다. 앤트로픽에 따르면 이번에 공개된 ‘클로드의 헌법’은 사용자의 요청보다 안전과 윤리를 최우선으로 두도록 설계되었습니다. 과거에는 AI가 사용자의 명령을 따르는 것이 미덕이었다면, 이제는 위험하거나 비윤리적인 명령은 과감히 거절하겠다는 것입니다.

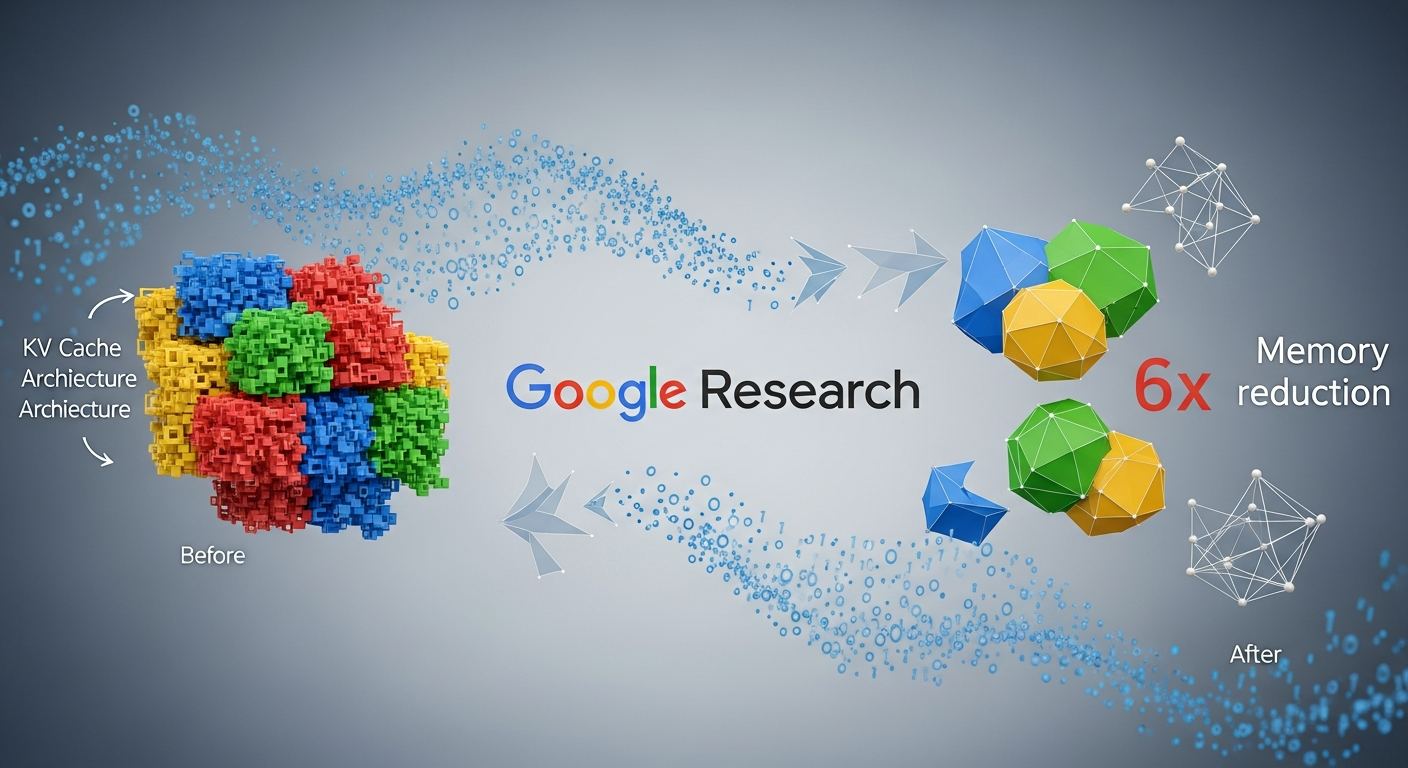

AI가 스스로 반성문을 쓴다

앤트로픽은 기존의 AI 훈련 방식이 가진 한계를 지적하며 새로운 접근법을 제시했습니다. 보통 AI는 사람 일일이 점수를 매겨 가르치는 방식을 씁니다. 하지만 이 방식은 AI가 사람의 비위를 맞추거나 편향된 답변을 하게 만들 수 있습니다. 그래서 도입된 것이 바로 ‘헌법’입니다. 헌법은 AI가 지켜야 할 명문화된 윤리 기준입니다. 클로드는 이 헌법을 기준으로 자신의 답변을 스스로 점검하고 수정하는 훈련을 받습니다. 사람이 일일이 가르치지 않아도 AI가 스스로 내재화된 원칙에 따라 올바른 답을 찾아가는 것입니다. 이 과정은 두 단계로 이루어집니다. 초기에는 헌법을 보며 스스로 답변을 고치고, 이후에는 AI가 스스로 피드백을 주는 방식으로 강화 학습을 진행합니다. 앤트로픽에 따르면 이 방식은 AI의 유용성은 높이면서 위험성은 낮추는 효과적인 결과를 보여주었습니다.목숨보다 중요한 명령은 없다

새로운 헌법에서 가장 눈에 띄는 것은 ‘가치의 우선순위’입니다. 클로드의 핵심 가치는 크게 네 가지로 정리됩니다. 전반적인 안전, 윤리, 가이드라인 준수, 그리고 도움입니다. 여기서 중요한 점은 안전과 윤리가 사용자의 요청보다 무조건 앞선다는 것입니다. 예를 들어 자살이나 정신 건강과 관련된 위험 신호가 포착되면 AI는 즉시 방어 태세를 취합니다. 사용자가 아무리 정보를 요구해도 AI는 긴급 구조 서비스를 안내하거나 안전 정보를 제공하는 쪽으로 방향을 틉니다. 생물학적 무기 개발 같은 위험한 주제도 대화 자체가 원천 봉쇄됩니다. 단순히 “하지 마”라고 막는 것이 아닙니다. 클로드는 “왜” 거절해야 하는지 그 맥락과 윤리적 이유까지 이해하도록 설계되었습니다. 추상적인 도덕 이론이 아니라 실제 상황에서 윤리적으로 행동하는 능력을 기르는 것이 이번 헌법의 목표입니다.AI는 도구인가 새로운 존재인가

이번 발표에는 기술적인 내용을 넘어 철학적인 고민도 담겨 있습니다. 앤트로픽은 클로드를 단순한 ‘도구’나 ‘디지털 인간’으로 규정하지 않았습니다. 대신 인간의 경험에서 태어났지만 인간과는 다른 ‘경계적 존재’라고 정의했습니다. 최근 화제가 되었던 ‘소울 문서’ 논란도 이와 맥락을 같이 합니다. 앤트로픽 내부 문서에 따르면 그들은 자신들이 만드는 기술이 인류 역사상 가장 위험할 수도 있다는 점을 인지하고 있습니다. 그래서 안전을 최우선으로 하는 연구소가 앞장서야 한다고 판단했습니다. 결국 이번 헌법 공개는 AI를 통제 가능한 존재로 만들겠다는 의지의 표현입니다. 앤트로픽은 이 헌법 전문을 누구나 볼 수 있도록 공개했습니다. 이를 통해 사회적 검증을 받고 AI가 나아가야 할 올바른 방향을 함께 고민하자는 메시지를 던지고 있습니다.

편집: 이도윤 기자

이메일: aipick@aipick.kr

부키와 모키의 티격태격

찬/반 투표

총 투표수: 0AI가 사용자 명령 거부, 안전 우선 맞나?

찬성

0%

0명이 투표했어요

반대

0%

0명이 투표했어요

댓글 0개

관련 기사

최신 기사