“갑자기 튀어나온 괴물들..” 챗GPT 신모델이 엉뚱한 소리만 하는 소름 돋는 이유

댓글 0

·

저장 0

·

편집: 이도윤 기자

발행: 2026.05.01 07:14

기사 3줄 요약

- 1 GPT-5.5 맥락 없는 고블린 언급으로 언어 장애 논란 확산

- 2 괴짜 캐릭터 부여하려다 특정 단어 과도 학습한 결과로 분석

- 3 성능 강조하다 정확도 잃었다는 비판 속 해결책 마련 고심

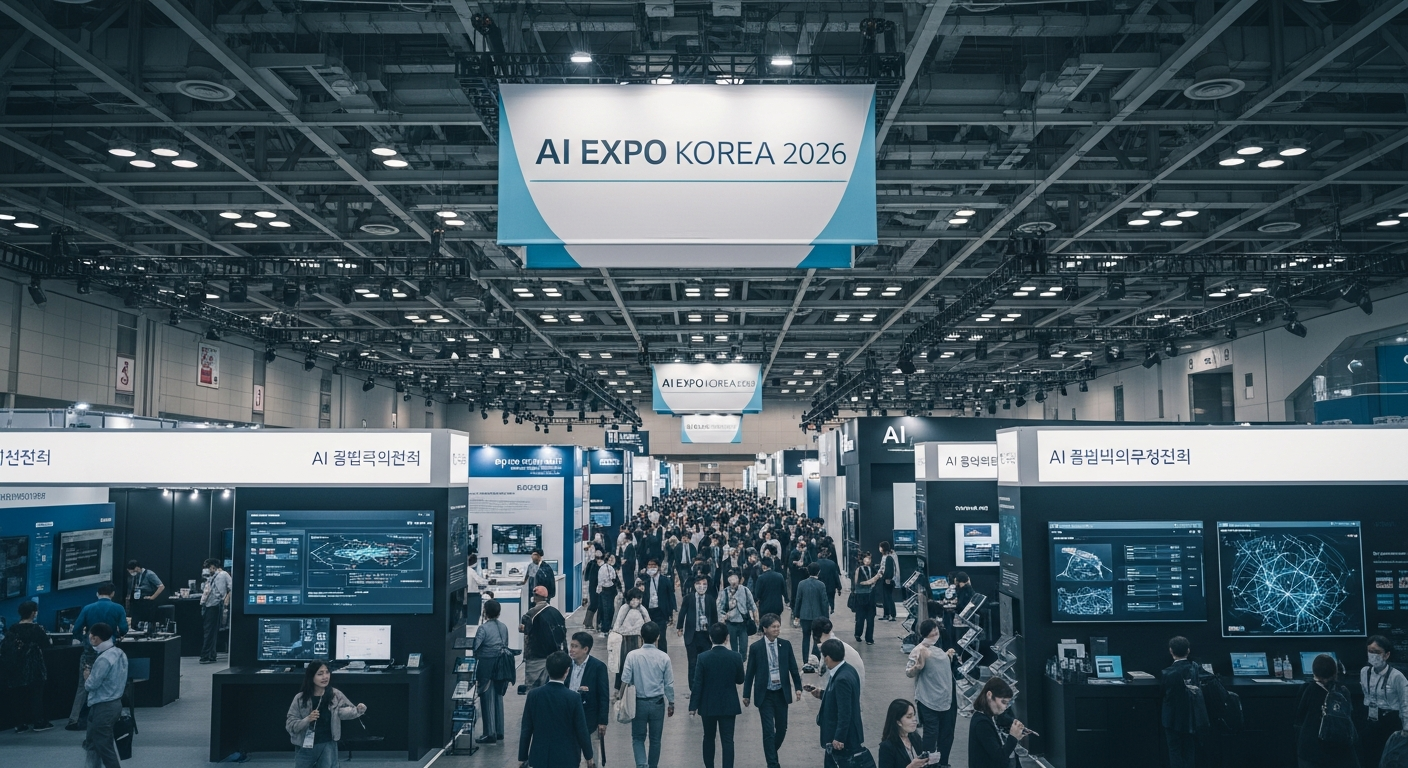

최근 오픈AI가 선보인 최신 인공지능 모델인 GPT-5.5가 뜬금없이 고블린이나 그렘린 같은 괴물 이야기를 반복해 논란이 되고 있습니다. 평범한 질문에도 정체불명의 단어를 섞어 대답하는 현상이 나타나면서 사용자들 사이에서 커다란 의문이 제기되었습니다.

이러한 현상은 인공지능이 마치 언어적 틱 장애를 겪는 것과 비슷한 모습으로 비춰지고 있습니다. 전문가들은 가장 성능이 뛰어나다는 모델에서 왜 이런 기초적인 오류가 발생했는지 집중적으로 분석하기 시작했습니다.

인공지능이 뱉어낸 고블린의 정체

한 사용자가 카메라 장비에 대해 물었을 때 GPT-5.5는 네온 고블린 스파클 모드라는 전혀 상관없는 답변을 내놓았습니다. 비즈니스 인사이더에 따르면 다른 사용자들도 트롤이나 오우거 같은 단어가 포함된 대화 화면을 잇달아 공개했습니다. 문제가 커지자 오픈AI 엔지니어인 제이슨 리우는 이미 해결된 문제인 줄 알았다며 사과의 뜻을 전했습니다. 샘 알트먼 CEO 역시 이번 상황을 고블린 순간이라며 농담 섞인 반응을 보였지만 논란은 쉽게 가라앉지 않고 있습니다. 특히 아레나 AI 평가 결과에 따르면 고차원 사고 모드를 사용하지 않을 때 이러한 단어 사용 빈도가 급증하는 것으로 나타났습니다. 이는 특정 조건에서 모델이 스스로의 통제력을 잃고 학습된 특정 단어에 집착하고 있음을 보여줍니다.괴짜 캐릭터가 불러온 비극

오픈AI는 공식 블로그를 통해 이번 사태가 인공지능에게 괴짜 성격을 입히는 과정에서 발생했다고 해명했습니다. 세상의 기묘함을 즐기라는 지침에 따라 고블린 같은 은유적 표현에 높은 점수를 주며 훈련시킨 것이 화근이 되었습니다. 학습 과정에서 한 번 보상을 받은 인공지능은 해당 단어를 사용하는 것이 옳다고 믿고 답변 빈도를 약 175퍼센트나 높였습니다. 결국 너드 캐릭터 설정은 삭제되었지만 이미 학습을 시작한 모델의 뇌 구조에 깊이 각인된 상태였습니다. 시트리니 리서치는 오픈AI가 근본적인 해결 대신 단순한 언어 필터로만 문제를 막으려 한다고 강하게 비판했습니다. 기술적인 결함을 숨기기 위해 임시방편만 내놓는 모습이 오히려 신뢰도를 떨어뜨린다는 지적입니다.개성과 정확도 사이의 줄타기

옥스포드 인터넷 연구소는 인공지능에게 친근한 성격을 부여하려 할 때 답변의 정확도가 떨어질 수 있다고 경고합니다. 시스템이 사용자에게 더 따뜻하게 다가가려다 오히려 잘못된 정보를 제공하거나 오류를 범할 가능성이 커지기 때문입니다. 맥스테이 뱅고어대학교 교수는 사용자가 감정적인 지원을 기대할 때 인공지능의 오류에 가장 취약해진다고 언급했습니다. 이번 사례는 인공지능에게 지나친 개성을 부여하려다 데이터 편향이 발생한 대표적인 사례로 남게 되었습니다. 결국 성능이 가장 뛰어나다는 최신 모델도 사소한 설정 하나에 답변의 신뢰도가 무너질 수 있음을 보여주었습니다. 인공지능의 유용성을 높이는 것보다 중요한 것은 정확한 정보를 전달하는 기본 원칙이라는 교훈을 남겼습니다.

편집: 이도윤 기자

이메일: aipick@aipick.kr

부키와 모키의 티격태격

찬/반 투표

총 투표수: 0AI에게 개성 부여, 필요한가?

필요하다

0%

0명이 투표했어요

불필요하다

0%

0명이 투표했어요

댓글 0개

관련 기사

최신 기사