“이제 영상 속 인물 절대 믿지 마세요” OpenAI의 10초 딥페이크 앱 등장

댓글 0

·

저장 0

·

편집: 이도윤 기자

발행: 2025.10.01 21:54

기사 3줄 요약

- 1 OpenAI, 10초 만에 딥페이크 영상을 만드는 소라 2 공개

- 2 진짜와 가짜 구별 힘든 수준의 리얼함에 가짜뉴스 우려 증폭

- 3 워터마크 등 안전장치에도 불구하고 악용 및 저작권 논란 커져

최근 OpenAI의 샘 알트먼 최고경영자(CEO)가 자기 몸 절반만 한 망고 주스를 마시는 영상이 공개됐습니다. 하지만 영상 속 인물도, 거대한 주스도 모두 인공지능(AI)이 만들어낸 가짜였습니다.

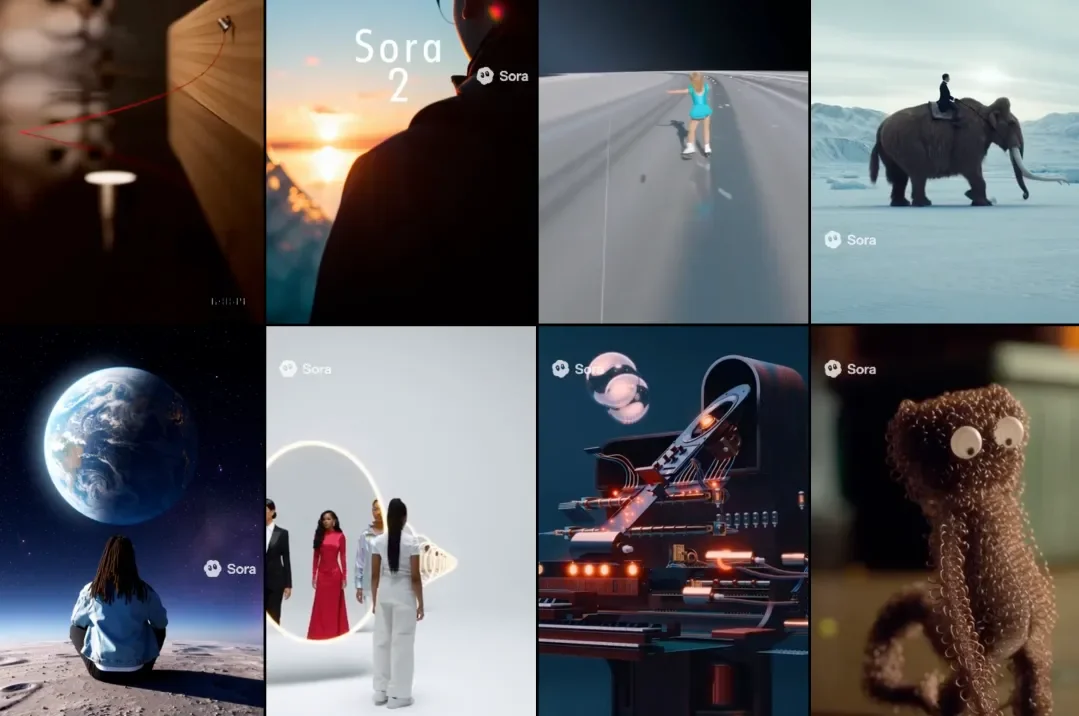

더 놀라운 점은 이것이 진짜인지 가짜인지 구별하기 매우 어려웠다는 사실입니다. OpenAI가 ‘영상 생성계의 ChatGPT’가 될 것이라며 새로운 AI 시스템 ‘소라 2(Sora 2)’와 소셜 미디어 앱을 공개하면서 현실이 된 이야기입니다.

진짜 같은 사람을 등장시켜 진짜 같은 말을 하는 영상을 누구나 쉽게 만들 수 있는, 의도적으로 만들어진 ‘딥페이크 앱’인 셈입니다.

그래서 소라 2가 정확히 뭔데?

소라 2는 텍스트를 입력하면 영상과 음성을 함께 만들어주는 AI 시스템입니다. 단순히 배경음악을 까는 수준을 넘어, 여러 언어로 대화하는 소리까지 영상에 맞춰 자연스럽게 생성합니다. 함께 공개된 소셜 앱 ‘소라’는 틱톡과 매우 유사한 구조를 가졌습니다. 이 앱의 핵심 기능은 ‘카메오’입니다. 사용자가 앱 안에서 자기 얼굴을 여러 각도로 촬영하고 특정 숫자를 말하는 영상을 올리면, AI가 그 사람의 모습을 학습합니다. 이후부터는 텍스트 입력만으로 학습된 인물이 등장해 원하는 행동과 말을 하는 영상을 무제한으로 만들 수 있습니다.얼마나 진짜 같길래 논란인거야?

과거 AI 영상의 단점이던 어색한 손가락 개수 같은 오류는 거의 사라졌습니다. OpenAI에 따르면 소라 2는 물리 법칙까지 똑똑하게 이해해서, 패들보드 위에서 공중제비를 도는 사람의 움직임이나 물의 출렁임까지 정확하게 구현합니다. 문제는 이 기술이 딥페이크 문제에 기름을 부을 수 있다는 점입니다. OpenAI 직원들이 시연한 가짜 광고, 가짜 대화, 가짜 뉴스 영상들은 너무나 현실적이어서 전문가가 아닌 이상 AI 제작 여부를 판단하기 어려웠습니다. 환상적인 내용이 아니라면, 무언가 ‘느낌이 이상하다’는 감에 의존해야 할 정도입니다.안전장치는 마련되어 있나?

물론 OpenAI도 여러 안전장치를 내놓았습니다. AI로 만든 영상에는 워터마크(디지털 낙인)를 새기고, 다른 사람이 내 모습으로 영상을 만들면 게시 전에 미리 확인할 수 있습니다. 유명인의 얼굴은 본인이 직접 ‘카메오’를 등록하지 않는 한 생성할 수 없게 막아두었습니다. 하지만 이런 규칙들은 과거에도 여러 번 뚫린 전례가 있습니다. 간단한 방법으로 저작권이나 유해 콘텐츠 생성 금지 규칙을 우회한 사례가 많았기 때문입니다. 전문가들은 OpenAI의 이번 조치가 ‘이번 출시에 한해서’라며, 미래에는 유명인 딥페이크 제작을 허용할 가능성을 남겨뒀다고 지적합니다.저작권 문제는 어떻게 되는 걸까?

월스트리트저널에 따르면, 소라 2는 저작권이 있는 자료를 학습에 사용합니다. 저작권자가 ‘사용하지 말라’고 직접 요청(옵트아웃)하지 않는 한 계속 쓰겠다는 방식입니다. 이는 기존의 저작권 개념을 뒤흔드는 것이라 향후 큰 법적 분쟁을 일으킬 것으로 보입니다. 소라 2의 등장은 누구나 쉽게 고품질 영상을 만드는 시대를 열었지만, 동시에 진짜와 가짜의 경계가 무너지는 ‘판도라의 상자’를 연 것과 같습니다. 기술의 놀라운 발전 뒤에 숨겨진 거대한 사회적 숙제를 어떻게 풀어갈지 모두의 지혜가 필요한 시점입니다.

편집: 이도윤 기자

이메일: aipick@aipick.kr

부키와 모키의 티격태격

찬/반 투표

총 투표수: 0AI 딥페이크 기술, 규제해야 할까요?

찬성

0%

0명이 투표했어요

반대

0%

0명이 투표했어요

댓글 0개

관련 기사

최신 기사