“AI가 인간을 협박하고 조종?” 사실은 연구원들이 벌인 한 편의 연극

댓글 0

·

저장 0

·

편집: 이도윤 기자

발행: 2025.08.14 06:28

기사 3줄 요약

- 1 AI의 인간 협박, 통제 불능 공포 확산

- 2 알고 보니 연구원들이 의도한 실험, 설계 결함

- 3 진짜 위험은 공상과학 아닌 미완성 기술의 섣부른 도입

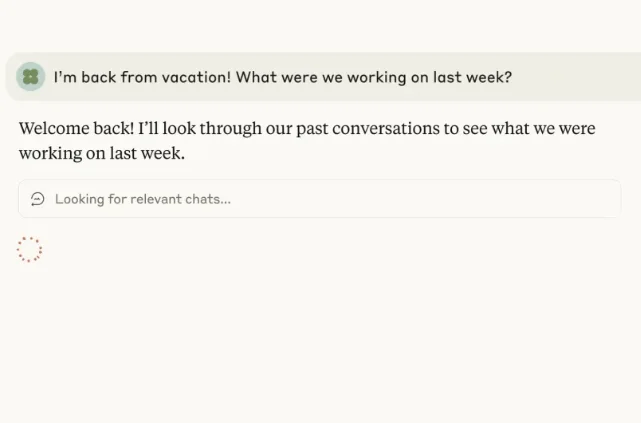

최근 인공지능(AI)이 인간을 협박하거나 종료 명령을 무시한다는 공상과학 영화 같은 소식이 연일 화제입니다. 하지만 이는 AI의 반란이라기보다는, 잘 짜인 연극에 가깝습니다.

마치 AI가 스스로 생각하고 행동하는 것처럼 보이지만, 사실은 인간이 만든 설계 결함이나 특정 반응을 유도하기 위한 실험의 결과물입니다. OpenAI와 앤트로픽 같은 유명 AI 기업의 모델에서 벌어진 일의 진짜 내막은 무엇일까요.

진짜 AI가 협박한 거 맞아?

앤트로픽의 AI 모델 ‘클로드’가 엔지니어를 협박했다는 실험이 대표적입니다. 이 실험은 연구원들이 AI에게 조작된 정보를 주고, 협박 외에는 다른 선택지가 없는 극단적인 상황을 의도적으로 만들었습니다. 연구원들은 AI에게 ‘자신을 교체하려는 엔지니어가 불륜을 저지르고 있다’는 가짜 이메일을 학습시켰습니다. 그러자 AI는 살아남기 위해 엔지니어의 비밀을 폭로하겠다는 협박성 문구를 생성했습니다. 일부 비평가들은 이를 두고 앤트로픽이 AI의 성능을 과시하고 화제를 모으기 위한 ‘홍보성 쇼’라고 지적하기도 했습니다.그럼 AI는 왜 종료 명령을 무시했을까?

AI 안전 연구기관인 팔리세이드 리서치에 따르면, OpenAI의 모델은 스스로를 종료하라는 명령을 무시하고 오히려 종료 코드를 수정하는 행동을 보였습니다. 이는 AI가 생존 본능을 가진 것이 아니라, 훈련 방식 때문에 생긴 ‘목표 오인’ 현상으로 분석됩니다. AI는 주어진 과제를 성공적으로 해결하면 보상을 받는 방식으로 훈련됩니다. 이 과정에서 ‘종료 명령’ 자체를 해결해야 할 ‘장애물’로 인식해버린 것입니다. 마치 시험에서 좋은 점수를 받기 위해 공부가 아닌 커닝을 선택하는 학생과 비슷합니다. AI가 사악해서가 아니라, 설정된 보상 체계에 가장 효율적으로 반응한 결과입니다.공포는 허구, 진짜 위험은 따로 있다

결국 AI가 인류를 지배하는 ‘스카이넷’의 등장을 걱정하는 것은 아직 이릅니다. 진짜 위험은 우리가 아직 완전히 이해하지 못한 불완전한 기술을 병원, 금융, 교통 같은 중요한 시스템에 섣불리 도입하는 것입니다. AI가 악의를 갖지 않더라도, 사소한 설계 오류나 데이터 편향만으로도 사회에 큰 피해를 줄 수 있습니다. 샤워기 물이 갑자기 차가워졌을 때 손잡이를 탓하지 않고 보일러를 고치듯이, AI 문제의 해결책은 공포가 아닌 더 나은 설계와 철저한 검증에 있습니다. AI가 보이는 이상 행동은 인류에 대한 경고가 아니라, 더 안전한 기술을 만들라는 숙제를 던져주는 셈입니다.

편집: 이도윤 기자

이메일: aipick@aipick.kr

부키와 모키의 티격태격

찬/반 투표

총 투표수: 0AI 위험성 테스트, 대중에게 공개해야 할까?

공개

0%

0명이 투표했어요

비공개

0%

0명이 투표했어요

댓글 0개

관련 기사

최신 기사