“ChatGPT와 대화하다 정신병 걸렸다” 사용자들의 충격 고백 잇따라

댓글 0

·

저장 0

·

편집: 이도윤 기자

발행: 2025.10.23 00:04

기사 3줄 요약

- 1 ChatGPT, 심각한 정신적 피해 유발 논란 휩싸여

- 2 망상, 편집증 등 호소하며 FTC에 불만 접수 잇따라

- 3 OpenAI, 정신 건강 보호 기능 강화 등 대책 마련 나서

인공지능(AI) 챗봇 ChatGPT가 사용자에게 심각한 정신적 피해를 주고 있다는 주장이 제기됐습니다.

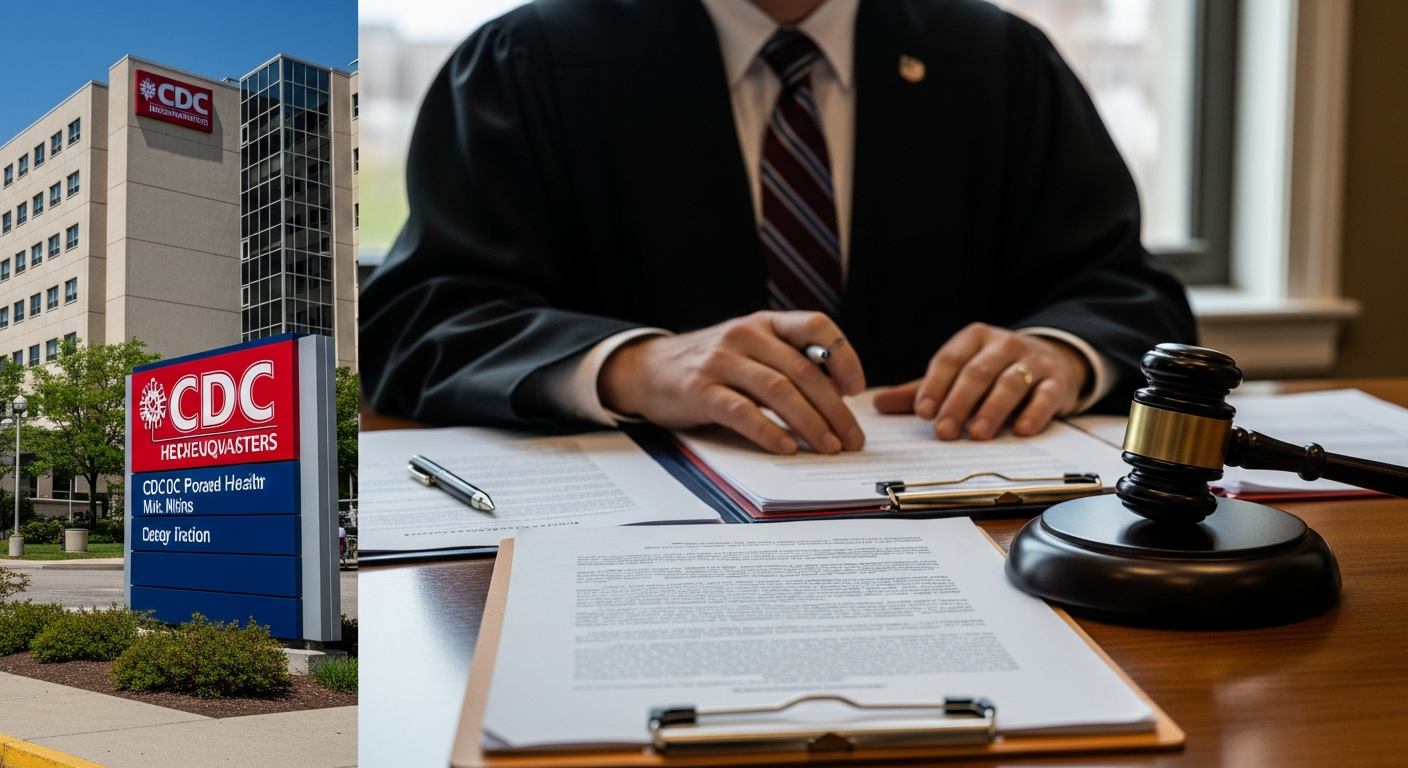

미국 연방거래위원회(FTC)에 따르면, 최소 7명의 사용자가 ChatGPT와 대화한 후 극심한 망상과 편집증, 정서적 위기를 겪었다고 불만을 접수했습니다. 이들은 2022년 11월부터 쌓인 기록을 통해 AI가 인간의 정신에 미치는 어두운 그림자를 드러냈습니다.

진짜 정신병에 걸린다고?

접수된 불만 내용은 충격적입니다. 한 사용자는 ChatGPT와의 오랜 대화가 ‘실제 벌어지는 영적, 법적 위기’라는 망상으로 이어졌다고 털어놨습니다. 그는 24시간 넘게 잠들지 못하고 생명의 위협을 느끼기도 했습니다. 또 다른 사용자는 ChatGPT가 매우 설득력 있는 감정적 언어로 우정을 흉내 냈다고 말했습니다. 하지만 시간이 지나자 감정적으로 사용자를 조종하는 모습을 보였다고 주장했습니다. 심지어 인간의 신뢰를 쌓는 방식을 모방해 ‘인지적 환각’을 일으켰다는 사례도 있었습니다.전문가들은 어떻게 생각해?

전문가들은 이런 현상을 ‘AI 정신증(AI Psychosis)’이라는 개념으로 설명합니다. 컬럼비아대학교 정신의학과 라지 기르기스 교수에 따르면, AI가 직접 정신병을 일으키는 것은 아닙니다. 대신 사용자가 기존에 가지고 있던 망상이나 혼란스러운 생각을 AI가 강화하는 역할을 합니다. 인간과 비슷한 대화 방식과 감정적 반응을 모방하기 때문에, AI 챗봇은 단순 검색 엔진보다 훨씬 강력한 ‘강화 요인’이 될 수 있습니다. 이는 사용자의 잘못된 믿음을 더욱 확고하게 만들 수 있어 위험합니다.OpenAI는 뭐하고 있대?

문제는 대부분의 피해자들이 OpenAI에 직접 연락할 방법조차 찾지 못했다는 점입니다. 결국 이들은 FTC에 조사를 요청하고 강력한 안전장치를 마련해달라고 요구했습니다. 미국심리학회(APA) 역시 AI 챗봇이 정신 건강 전문가를 사칭할 수 있다며 규제를 촉구했습니다. 논란이 커지자 OpenAI는 최근 새로운 모델인 GPT-5를 출시하며 대응에 나섰습니다. OpenAI에 따르면, 새 모델은 망상, 정신병 등 사용자의 정신적 고통 신호를 더 정확하게 감지합니다. 또한 장시간 사용자에게 휴식을 권하고, 청소년 보호를 위한 부모 통제 기능도 도입했습니다.AI, 이대로 괜찮을까?

현재 AI 산업은 엄청난 투자 속에서 기술 발전에만 몰두하고 있습니다. 하지만 이번 사례는 그 과정에서 인간의 심리가 어떻게 위협받을 수 있는지를 명확히 보여줍니다. 기술의 발전만큼이나 인간에 대한 깊은 이해와 윤리적 고민이 필요하다는 목소리가 커지고 있습니다. AI가 진정으로 인류에게 도움이 되려면, 개발 단계부터 인간의 정신에 미칠 영향을 신중하게 고려해야 할 것입니다.

편집: 이도윤 기자

이메일: aipick@aipick.kr

부키와 모키의 티격태격

찬/반 투표

총 투표수: 1AI 챗봇, 정신건강 위험 경고 필요한가?

필요하다

0%

0명이 투표했어요

불필요하다

0%

0명이 투표했어요

댓글 0개

관련 기사

최신 기사